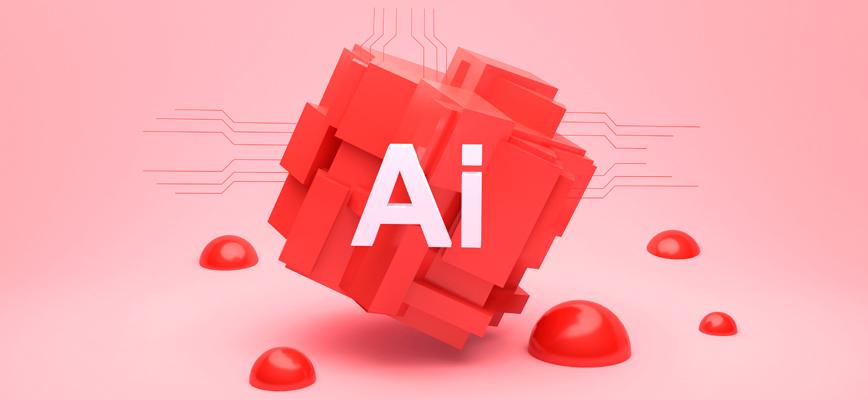

¿Cómo podemos abordar la revolución que está suponiendo la inteligencia artificial en el entorno laboral sin perder la cabeza? ¿Qué reglas debemos establecer para que la IA no nos arrastre a lugares donde no queremos estar? Ha llegado el momento de reformular las leyes que Isaac Asimov elaboró para evitar que la inteligencia artificial dañe a la humanidad.

Un nuevo marco para la IA inspirado en las leyes de la robótica

BC

Barry Cooper

Business Review (Núm. 348) · TIC · Octubre 2024

La realidad es que la innovación no es algo nuevo: desde la imprenta hasta el sistema de producción en cadena, pasando por los chips informáticos, las empresas siempre han tenido que adaptarse a los nuevos tiempos para mantenerse a flote. Pero ¿qué hacemos cuando el progreso es más rápido que nuestra capacidad de adaptación? A nada que nos descuidemos, parpadeamos y nos quedamos desfasados: la competencia ya nos ha tomado ventaja.

Es necesario decidir un marco mental que guíe nuestras reflexiones sobre la inteligencia artificial. En ese sentido, aquí se proponen cuatro leyes que deberíamos cumplir para que nuestras empresas prosperen.

La referencia de las leyes de Asimov

A mediados del siglo pasado, el autor de ciencia ficción y científico Isaac Asimov enunció tres leyes para la inteligencia artificial a las que se sigue haciendo referencia en la actualidad. Ante el avance de la robotización y el potencial de desarrollo de la IA que se adivinaba, Asimov intentó visualizar cómo podrían funcionar mejor los robots en un mundo humano.

Sus leyes aparecieron por primera vez en los años cuarenta y se hicieron populares a partir de la publicación de Yo, robot, que recopilaba diversos relatos suyos de ciencia ficción:

• Primera ley: un robot no hará daño a un ser humano ni, por inacción, permitirá que un ser humano sufra daños.

• Segunda ley: un robot debe obedecer las órdenes que le den los seres humanos, excepto cuando estas entren en conflicto con la primera ley.

• Tercera ley: un robot debe proteger su propia existencia siempre que dicha protección no entre en conflicto con la primera o la segunda ley.

Posteriormente, Asimov añadió una “ley cero”, que tiene prioridad sobre las demás leyes:

• Ley cero: un robot no puede dañar a la humanidad ni, por inacción, permitir que la humanidad sufra daños.

Este marco de conducta de los robots constituye un aspecto fundamental del universo ficticio de Isaac Asimov y también ha suscitado debates éticos y tecnológicos por su influencia en las directrices de los sistemas de IA.

Reformulando las leyes de la IA

¿Son adecuados estos planteamientos? ¿Se trata de leyes realmente aplicables? Si bien es cierto que enunciadas así son claras y concisas para no...

Barry Cooper

Director de The Global College ·

Artículos relacionados

La empresa y la 'Web 2.0'

ED